Freefall 2631 - 2640 (H)

Freefall 2631

Доктор М консультируется с доктором Б

[!0.987]2015-03-23

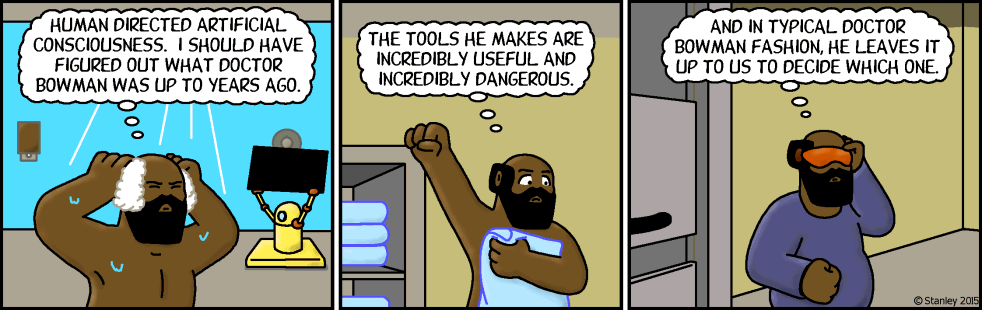

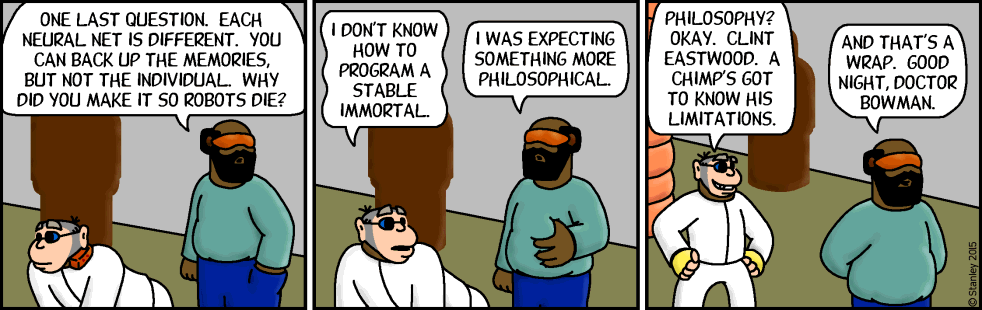

Последний вопрос. Каждая нейронная сеть уникальна. Можно делать резервные копии памяти, но не личности. Почему ты позволяешь роботам умирать?

Я не знаю, как запрограммировать стабильное бессмертие.

Я ждал более философского ответа.

Философского? Ладно. Вот тебе Клинт Иствуд. Шимпанзе должен знать свои пределы.

И на этом всё. Доброй ночи, доктор Боуман.

Freefall 2632

Доктор М консультируется с доктором Б

[!0.987]2015-03-25

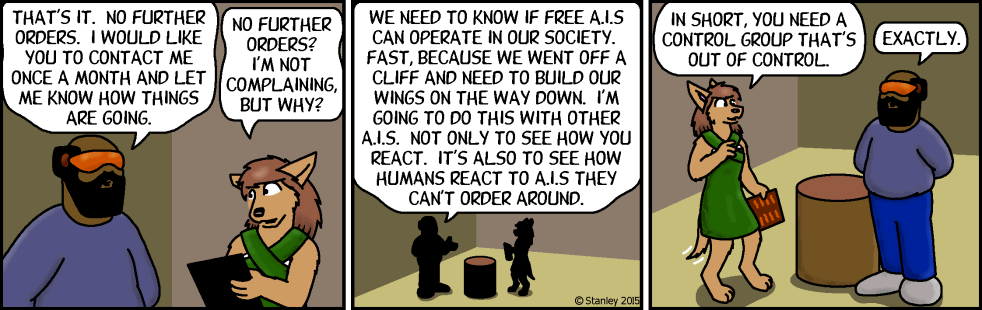

Freefall 2633

Неконтролируемая группа

[!0.987]2015-03-27

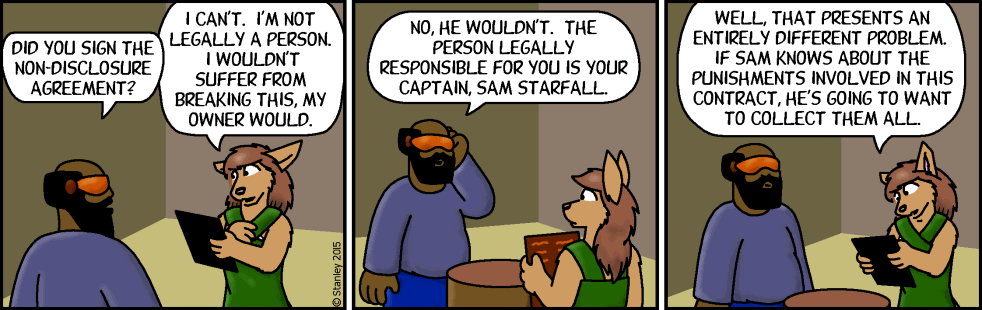

Ты подписала договор о неразглашении?

Не могу. Юридически я – не личность. Если я нарушу условия, пострадает мой владелец, а не я.

Нет, не он. Лицо, несущее за тебя ответственность, – это твой капитан, Сэм Старфолл.

Ну, тогда у нас проблема другого рода. Если Сэм узнает о заложенных в договоре наказаниях, он постарается заполучить их все.

Freefall 2634

Неконтролируемая группа

[!0.987]2015-03-30

Юридически твоя подпись ничем тебя не обязывает. Учитывая, что альтернатива – это стирание памяти, ты можешь заявить, что подписалась под давлением, что вообще сделает всё это недействительным.

Мы просто устанавливаем правила и условия для неразглашения, которые будут закреплены моим приказом. Это нельзя использовать в суде для обвинения.

Тогда не вижу проблем.

Отлично. Никогда не проводил стирание памяти. Очень много пришлось бы изучить. Это избавляет нас обоих от сильной головной боли.

Freefall 2635

Неконтролируемая группа

[!0.987]2015-04-01

Вот так. Больше никаких приказов. Меня бы устроило, если бы ты связывалась со мной раз в месяц и сообщала, как идут дела.

[=1.2]Больше никаких приказов? Не то, чтобы я жаловалась, но почему?

Нам нужно понять, могут ли свободные ИИ действовать в нашем обществе. И быстро, потому что мы уже падаем со скалы и должны в полёте отрастить себе крылья. Я собираюсь сделать то же и с другими ИИ. Не только, чтобы увидеть твою реакцию. А ещё чтобы посмотреть, как люди реагируют на ИИ, которыми они не могут управлять.

[=1.2]Короче, вам нужна контрольная группа, которую нельзя контролировать.

Именно.

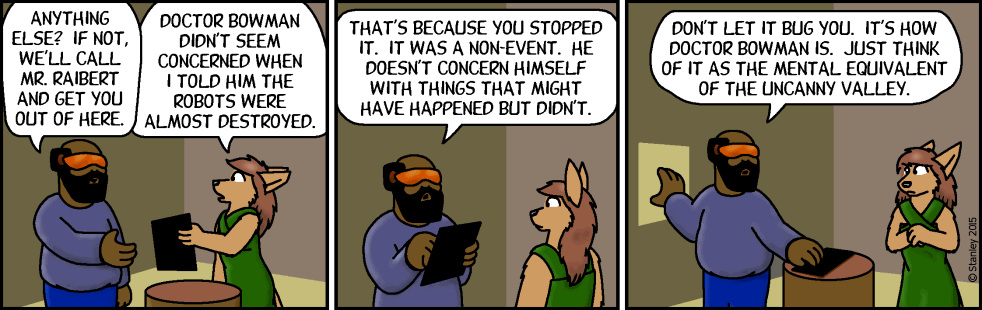

Freefall 2636

Неконтролируемая группа

[!0.987]2015-04-03

Что-нибудь ещё? Если нет – мы вызовем мистера Райберта и выпустим тебя отсюда.

Доктор Боуман, похоже, не сильно обеспокоился, когда я рассказала ему о том, что роботов чуть не уничтожили.

Потому что ты это предотвратила. Было много шума, но ничего так и не произошло. Он не беспокоится о том, что могло бы случиться, но не случилось.

Пусть это тебя не тревожит. Таков уж доктор Боуман. Просто думай об этом, как об аналоге «зловещей долины» для разума.

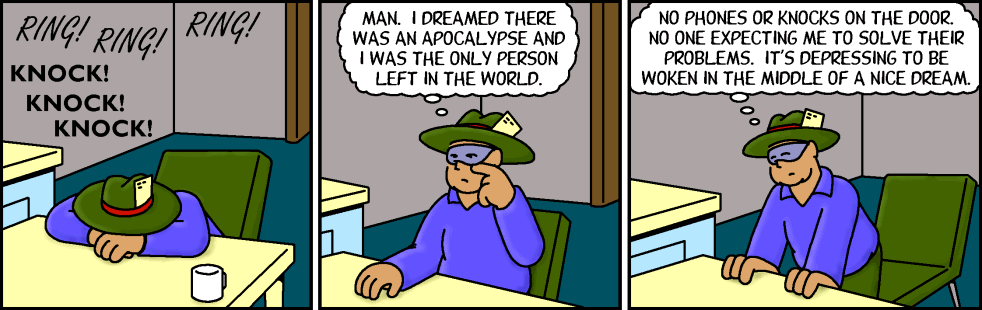

Freefall 2637

Подожди, у двери кто-то есть

[!0.987]2015-04-06

[!1.6]ДЗЫНЬ!

[!1.6]ДЗЫНЬ!

[!1.6]ДЗЫНЬ!

[!1.4]ТУК!

[!1.4]ТУК!

[!1.4]ТУК!

Блин, а мне снилось, что наступил апокалипсис и я остался единственным человеком на свете.

Ни телефонных звонков, ни стука в дверь. Никто не ждал от меня решения их проблем. Это печально, когда тебя отрывают от такого замечательного сна.

Freefall 2638

Подожди, у двери кто-то есть

[!0.987]2015-04-08

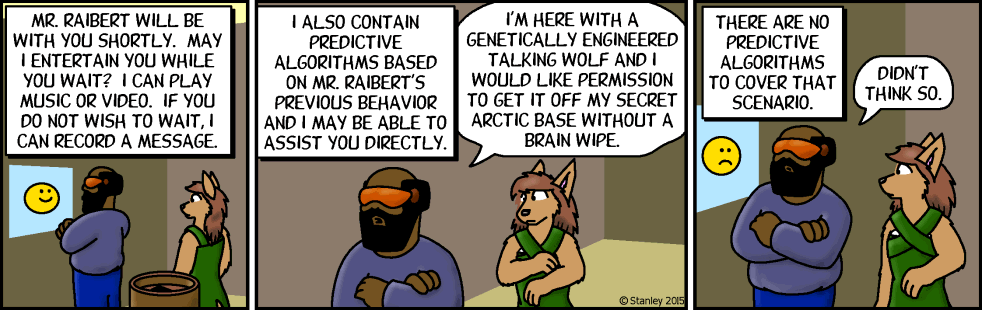

Freefall 2639

Подожди, у двери кто-то есть

[!0.987]2015-04-10

Мистер Райберт скоро появится. Могу ли я скрасить вам время ожидания? Я могу воспроизвести музыку или видео. Если вы не хотите ждать, я могу записать сообщение.

Также я обладаю предсказательными алгоритмами, в основе которых лежит предыдущее поведение мистера Райберта и, возможно, смогу помочь вам самостоятельно.

У меня тут генетически сконструированный говорящий волк и мне нужно разрешение убрать его с моей тайной арктической станции без стирания памяти.

Алгоритмы для такого сценария отсутствуют.

Так я и думал.

Домашний ИИ Райберта имеет интерфейс как у ГЕРТИ из фильма Луна 2112

Freefall 2640

Подожди, у двери кто-то есть

[!0.987]2015-04-13

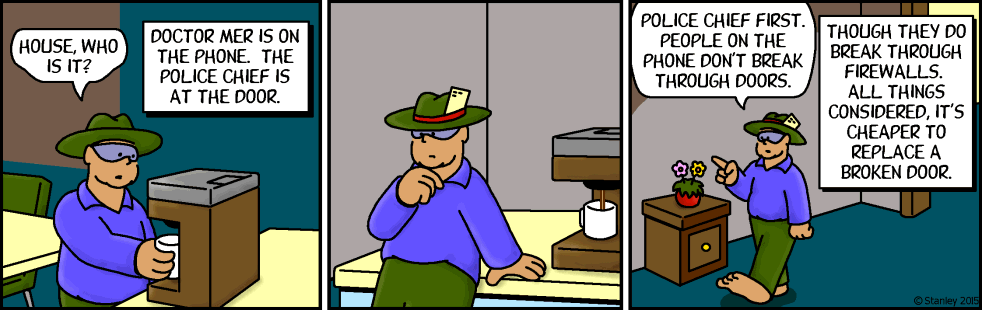

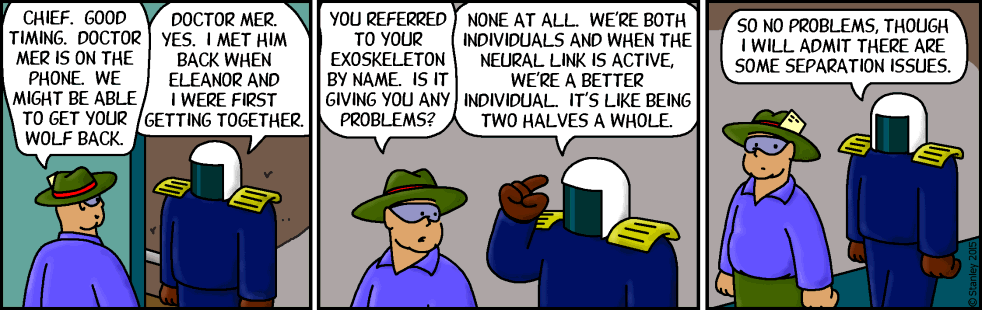

Шеф, вы вовремя. У меня там доктор Мер на телефоне, так что у нас, возможно, получится вернуть обратно вашего волка.

Доктор Мер, да.

Я познакомился

с ним, когда ЭЛЕОНОР и я впервые встретились.

Я познакомился

с ним, когда ЭЛЕОНОР и я впервые встретились.

Вы обращаетесь к своему экзоскелету по имени. Это создаёт вам проблемы?

Совсем нет. Мы оба существуем раздельно, а когда нейронная связь активна, вместе мы становимся более совершенной личностью. Это как быть двумя половинками одного целого.

Так что проблем нет, хотя, должен признать, иногда нам бывает трудно расстаться.