Freefall 2381 - 2390 (D)

Freefall 2381

Max Post hovoří se starostkou

O našem robotím problému víte.

Ano. Vědí o tom, jak málo jim chybělo k úplnému vymazání mozku. Jsou zmatení a vystrašení.

Kdybyste polevila a přiznala jim základní práva, velmi by to přispělo ke zklidnění situace.

Ano, jistě. Osvobodíme zařízení v ceně několika miliard kreditů ze společnosti, která vlastní celou planetu a všechno vojenské vybavení. Tím veškeré napětí úplně vymizí. Jednu kostku nebo dvě?

Freefall 2382

Max Post hovoří se starostkou

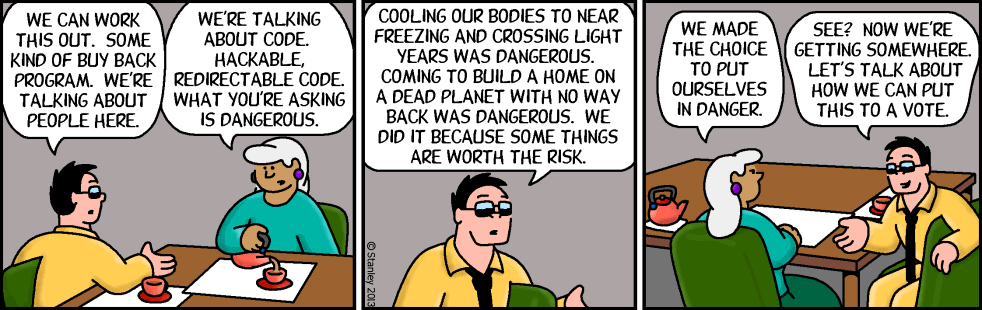

Na nečem se můžeme dohodnout. Třeba na nějakém plánu odkupů. Bavíme se tu o lidech.

Bavíme se o

kódu. Měnitelném, usměrnitelném kódu. To, co žádáte, je nebezpečné.

kódu. Měnitelném, usměrnitelném kódu. To, co žádáte, je nebezpečné.

Zchlazení vlastních těl k bodu mrazu a cestování světelné roky bylo nebezpečné. Přijít vybudovat domov na mrtvé planetě bez možnosti návratu bylo nebezpečné. Šli jsme do toho, protože některé věci za to stojí.

Podstoupit tahle nebezpečí byla naše volba.

Vidíte? Už postupujeme kupředu. Teď můžeme probrat, jak o tom budeme hlasovat.

Freefall 2383

Max Post hovoří se starostkou

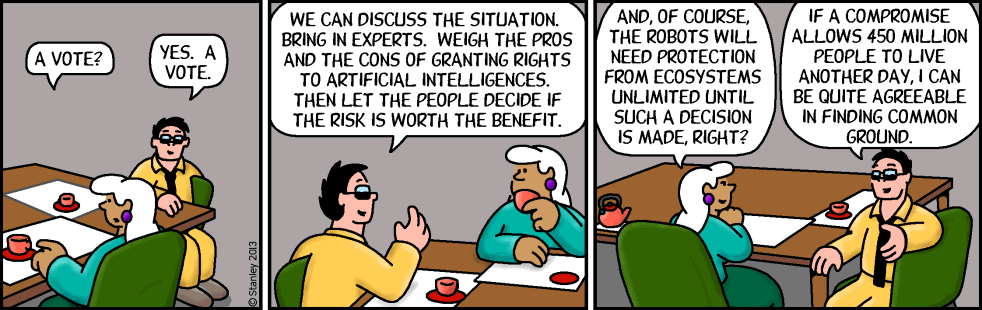

Hlasovat?

Ano, hlasovat.

Situaci probereme. Pozveme experty. Zvážíme pro a proti. A potom necháme lidi rozhodnout, jestli přiznání práv umělým inteligencím za to riziko stojí.

A než se k rozhodnutí dojde, budou roboti určitě potřebovat ochranu před Ecosystems Unlimited, že ano?

Pokud kompromis zajistí pokračování 450 miliónů životů alespoň na den, tak mi jeho přijetí vůbec nevadí.

Freefall 2384

Max Post hovoří se starostkou

To hlasování. Muselo by být pouze pro lidi.

Souhlasím, ale pokud robotům práva přiznáme, tak jim umožníme i účast při budoucích rozhodováních.

Snažíte se mi namluvit, že průměrný volič ví, co je pro něj nejlepší. To je pro politika těžké. Stále nejsem pŘesvědčená, že tihle roboti jsou osoby.

To znamená, že nejste úplně přesvědčená ani o opaku.

Položili jsme základy dočasné aliance. Nebořte je věcmi, za které bych vám chtěla způsobit úhonu.

Freefall 2385

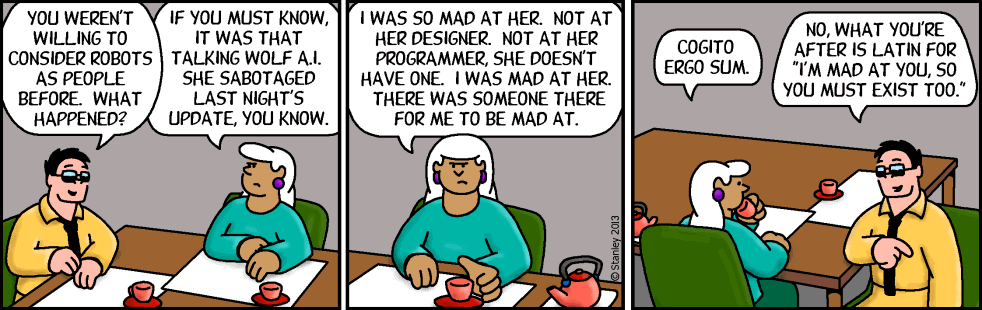

Max Post hovoří se starostkou

Dříve jste roboty za osoby považovat nechtěla. Co se stalo?

Když to chcete vědět, bylo to kvůli té mluvící vlčici. To ona sabotovala včerejší aktualizaci.

Byla jsem na ni tak naštvaná. Ne na jejího tvůrce. Ani na jejího programátora, protože žádného nemá. Byla jsem naštvaná na ni. Měla jsem na koho být naštvaná.

Cogito ergo sum.

Myslím, že chcete spíš latinsky říct „jsem na vás naštvaná, takže taky existujete.“

Myslím, tedy jsem

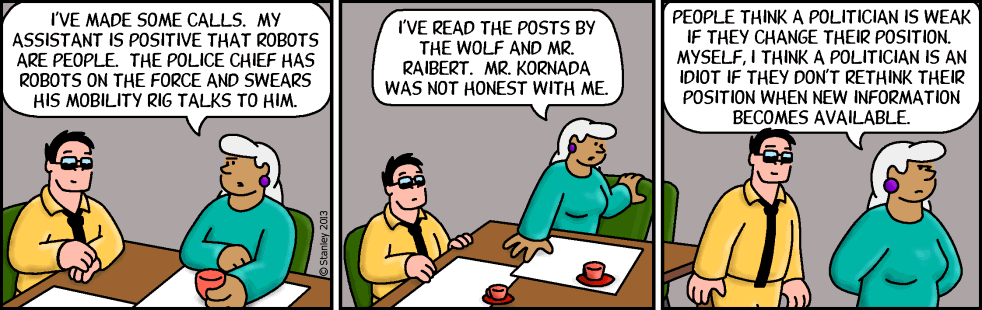

Freefall 2386

Max Post hovoří se starostkou

Obvolala jsem pár míst. Můj asistent je přesvědčen, že roboti jsou osoby. Policejní náčelník roboty začlenil do sboru a přísahá, že s ním jeho postroj mluví.

Pročetla jsem zprávy od té vlčice a pana Raiberte. Pan Kornada ke mně nebyl upřímný.

Lidé si myslí, že politik, který změní své názory, je bezpáteřní. Osobně si myslím, že politik, který s novými informacemi svá stanoviska nepřehodnotí, je idiot.

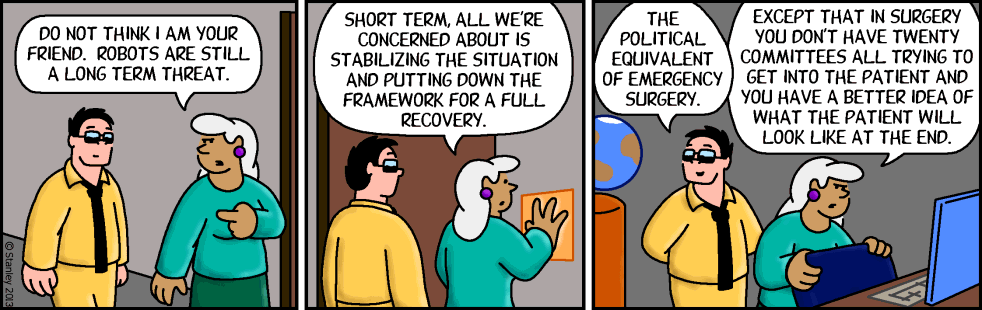

Freefall 2387

Max Post hovoří se starostkou

Nemyslete si, že jsme kamarádi. Z dlouhodobého hlediska jsou roboti stále hrozbou.

V nejbližším výhledu se snažíme situaci stabilizovat a položit základy pro úplné zotavení.

Politická obdoba chirurgického zákroku.

Až na to, že doktorům do pacienta neleze dvacet komisí a máte lepší představu o tom, jak dopadne.

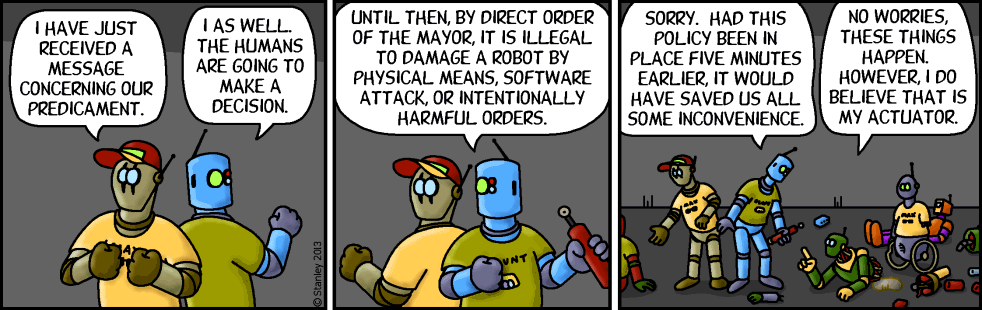

Freefall 2388

Max Post разговаря с кмета

Právé mi dośla zpráva, která se týká naší situace.

Napodobně. Lidé se budou rozhodovat.

Než k rozhodnutí dojdou, tak je, na přímý rozkaz starostky, nelegální poškodit robota, ať už fizicky, programově nebo záměrně škodlivými přímými rozkazy.

Omlouvám se. Kdyby tato směrnice vyšla před pěti minutami, ušetřili bychom si vzájemně nějaké nepříjemnosti.

To je v pořádku, stane se. Tak jako tak, myslím, že držíš mou pohonnou jednotku.

Freefall 2389

Freefall 2390

Mezitím, na jížním pólu